News - Дезінформація від штучного інтелекту провокує расову напруженість і політичний вплив

Business Strategy

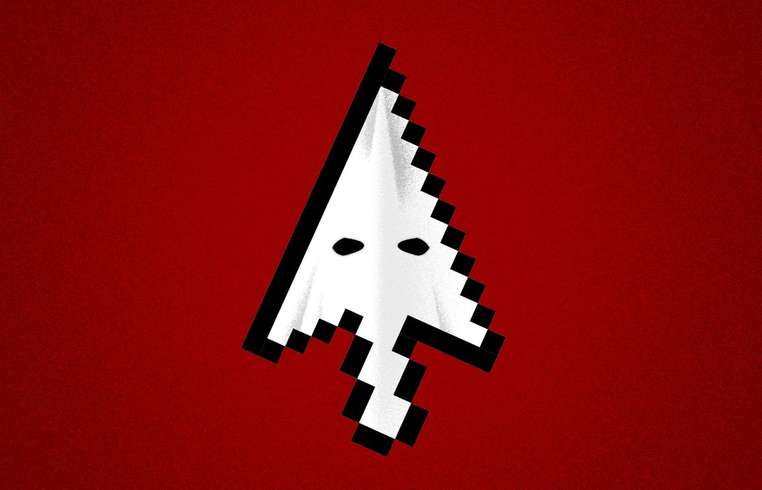

Дезінформація від штучного інтелекту провокує расову напруженість і політичний вплив

У мінливому середовищі штучного інтелекту створення та поширення AI-генерованих відео стало надзвичайно легким та переконливим. Ця легкість створення, за допомогою таких інструментів, як OpenAI's Sora та Google's VEO 3, сприяє розповсюдженню штучного контенту, що стає все важче відрізнити від автентичних матеріалів. Ці досягнення породили нове цифрове явище, схоже на 'блекфейс', коли небіли особи створюють відео з чорною або коричневою персоною для отримання соціальної валюти, такої як лайки, поширення, а в деяких випадках, фінансові вигоди. Ця тенденція має тривожні наслідки, особливо в умовах, коли платформи соціальних мереж стимулюють створення контенту через дохід від переглядів. Некошерність цих AI-генерованих відео проявляється не лише в їх оманливій природі, а й у потенціалі підтримувати расові стереотипи та впливати на громадську думку. Серія шахрайських відео, у яких нібито обговорюються зловживання пільгами SNAP під час закриття уряду, спричинила хвилю ворожості в мережі. Ці відео підтримували шкідливий стереотип про чорних жінок як 'королев добробуту', що на жаль, викликало у деяких користувачів обурення стосовно програми SNAP. Цікаво, що статистика суперечить цьому наративу, вказуючи на те, що більшість отримувачів SNAP — це неіспаномовні білі особи. Та все ж, привабливість контенту, що здається підтвердити упереджені думки, часто призводить до того, що користувачі нехтують фактами заради емоційного резонансу. Ця динаміка підкреслює потужний вплив дезінформації на соціальні платформи. Майкл Гаґґінс з групи правосуддя щодо рас Color of Change підкреслив психологічний вплив такого вигаданого контенту. Навіть коли глядачі ідентифікують контент як помилковий, його негативні асоціації можуть непомітно проникнути в колективну свідомість, формуючи ставлення до реальних проблем, включаючи політичні вибори. Хоча деякі технологічні компанії роблять кроки для зменшення поширення маніпулятивного контенту, впроваджуючи політики проти мови ненависті та дезінформації, ще є багато чого, що треба зробити. OpenAI та Google впровадили різні заходи безпеки, такі як заборона на використання образливих слів та впровадження цифрових водяних знаків, щоб сигналізувати про AI-генерований контент. Втім, досяжність та вплив цих відео продовжують створювати значні виклики. Згідно з організаційним психологом Дженісом Гассамом Асаре, легковажність, з якою такий контент часто споживається, саме по собі робить його настільки небезпечним. Вона закликає до розважливості серед споживачів соціальних мереж, заохочуючи критичне оцінювання автентичності контенту. Ця постійна боротьба проти дезінформації, створеної AI, вказує на більш широкі тенденції цифрової трансформації та соціально-політичної динаміки, підкреслюючи важливість підвищеної обізнаності та відповідальності платформ для захисту суспільних цінностей та демократичних процесів.